2023年12月23-24日,由北师大科研院、珠海校区科研管理办公室和北师大人文和社会科学高等研究院共同指导,由北师大珠海校区人工智能伦理治理实验室、北京伦理学学会、湖北省伦理学学会、广东省伦理学学会和重庆市伦理学学会联合主办,由教育部人文社科重点研究基地价值与文化研究中心、睿抗机器人开发者大赛组委会、《山东社会科学》杂志社、《pp电子游戏网站学报》编辑部、武汉 大学应用伦理学研究中心和《应用伦理研究》编辑部协办,人工智能伦理治理研修会暨京鄂粤渝伦理学学会2023年年会在珠海举办,来自北京、湖北、广东、重庆以及其山东、上海、河北、河南、内蒙古伦理学学会的专家学者逾110人参 与本次会议,做了不同形式的学术报告,共计约40余场。本次会议是人工智能伦理治理工作坊系列一“人工智能的伦理审视”、系列二“人工智能时代的社会治理及共同体构建”、系列三“人工智能伦理治理及实验室建设”、系列四“人工智能教育伦理与伦理教育”之后的“升级版”。涉及议题更广、参会人员更多、会议结构更丰富。

12月23日上午8:30开幕,开幕式由北师大人文和社会科学高等研究院副院长李家永主持。

北京师范大学学术委员会主任韩震教授首先致开幕辞。韩教授对各位嘉宾莅临相对温暖的南国北师参加人工智能伦理治理研修会暨京鄂粤渝四省市2023年伦理学会年会表示热烈欢迎。他指出,每一次技术的进步都极其深刻地改变了人类社会的生活,并引发一系列的伦理问题。当下的人工智能技术更是极大地挑战了人类的现实生活。因此,会议议题非常重大。他希望,与会嘉宾借助于人工智能伦理治理实验室提供的平台,充分展开交流与对话,取得丰富的学术成果,为智能时代的到来积极做好思想准备、理论准备。

北京师范大学珠海校区科研办公室副主任石文在致辞中表示,他受北师大党委副书记、珠海校区党委书记韦蔚和珠海校区科研管理办公室主任左瑞的委托对远道而来的各位学者表示热烈的欢迎,向一直以来支持我校人工智能伦理治理学科发展的各位专家表示。衷心的感谢!他介绍指出,珠海校区是按照学校“一体两翼”办学格局和高标准新机制国际化的原则打造的,与北京校区同一水平的南方校区,人工智能伦理治理实验室是在广东省“冲补强”专项资金支持下,珠海校区通过“揭榜挂帅”专项评审,在校内遴选中产生的唯一新文科类重点科研平台。人工智能伦理治理实验室自立项建设以来,开展了大量的科学研究和学术活动。他希望人工智能伦理治理实验室在各位专家学者的大力支持下,提前谋划,群策群力,早日打造成为省部级科研平台,为我国的科技伦理建设做出更多的贡献。他祝愿各位专家畅所欲言,百家争鸣,百花齐放,产生思想火花,取得圆满成功。

接下来,北京伦理学学会会长王淑芹教授、广东省伦理学学会副会长陈联俊教授、重庆市伦理学学会副会长兼秘书长任丑教授、湖北省伦理学学会副会长兼秘书长李家莲教授以及北京师范大学人工智能伦理治理实验室主任、湖北省伦理学学会会长戴茂堂教授分别在开幕式上分别做了致辞。

王淑芹在致辞中表示,会议无论在形式上还是在内容上都具有重要的意义,既有利于各个伦理学学会的会员之间的相识和交往,也有利于多区域的研究者来共同探讨同一个问题。她认为,以研修会的形式召开伦理学学会的年会,是一种探索和创新,特别有利于在一个非常优美的自然环境之下,各位学者无任何负担敞开胸怀来享受学术,感受思辨的快乐!他还认为,就人类的科技与人类道德的关系问题而言,人工智能伦理治理是一个古老的问题。就新一代的人工智能技术而言,这个话题又是一个热点问题。这个话题之所以成为热点问题,是因为它关乎到了人类未来的命运以及人类未来发展的走向,危及到了人类的安全和尊严。人工智能技术一旦出现,就会涉及人的利益,必须有、也必然有道德的规范和调控与之相伴随。这正好体现了伦理学的应用性力量、实践性特征。期待这次会议成为我们以后交流这个主题的时候的一个很重要的里程碑式的节点。

陈联俊在致辞中表示,首先,人工智能集中体现了人类的知识力量,是物化的知识形态,反映了人类文明的前沿智慧,促进了生产力的巨大进步。其次,人工智能反映了人类的价值追求和价值抉择。人类每一次技术上的努力都是为了改变生活,解放自身。因此,人工智能深层次看代表的是一种精神。第三,人工智能蕴含了人类技术的双面价值效应。人工智能一方面创造生产力和物质财富,帮助我们从繁重的劳动中解放出来,但同时又带来了巨大风险,让我们人类自身在自己的创造物面前慢慢失去信心和尊严。人工智能的广泛应用可能会导致我们对技术价值的过度依赖,失去对技术发展的掌控力。智能化水平会带来价值鸿沟,人工智能的意识形态风险还会引发民族主义种族主义的社会问题,破坏社会和谐稳定。一个人,一个国家一个文明要想保持自己的自主性和独立性,都要在保持技术理性和价值理性的平衡中,加强对人工智能的伦理监管,确保技术发展和应用有利于塑造美好生活,符合人类的价值和利益。

任丑在致辞中表示,自2019年以来,我们国家非常重视科技伦理的治理。2019年就成立了国家科技伦理委员会。2022年,中办国办印发了关于科技伦理治理的意见。医学伦理、生命伦理是比较成熟的科技伦理领域,而人工智能伦理严格说来是刚刚兴起的、前沿而紧迫的科技伦理领域。人工智能的出现与自然智能的脆弱性相关,是人类理智要求不断自我增强的结果。人工智能和自然智能融为一体将成为一个影响我们人类未来发展的一个趋势。他还认为,以往,哲学门类下面只有一个一级学科八个二级学科,全部都是学术型的。现在,有了应用伦理作为哲学的专业硕士点。这给我们传递了一个重要的信号,人工智能伦理也将通过应用伦理专业的建设展现出巨大的实践力量,并展现出哲学的无用之大用。

李家莲在致辞中主要讨论了人工智能伦理治理中的情感问题。首先,她认为,人类心灵的本性是情感而不是理性。对此,18世纪人类社会出现的第一次启蒙运动中,苏格兰启蒙学派的思想家斯密和休谟等都进行了论述。其次,她认为,对于以情感为本性的人类心灵来说,支配人类道德判断和文明的是情感机制。情感机制是大自然治理万物的管治之道。再次,她认为,支配情感机制的内在法则是中国哲学的阴和阳这样的一对概念,而不是以爱恨为表现形式的欲望或者是情感。最后,她认为,人工智能的伦理法则必须是情感法则,而不能是理性法则。

戴茂堂在致辞中表示,这次大会体现了几大融合:一是主讲嘉宾从科学社会史、法哲学、国际伦理、医学哲学、经济伦理、西方伦理介入人工智能伦理治理这个主题,各有侧重,但又相互融通。二是将研修会与学会年会捆绑、打通和叠加在一起,从学术和学会的角度思考一些共同的话题,形成更好的对话和更严的交锋环境。既有学会的味道,又有研讨会的品质。这是一个新的尝试。三是将北京伦理学会、湖北省伦理学学会、广东省伦理学学会、重庆市伦理学学会聚集在一起,围绕人工智能伦理治理,形成了更加广泛的学术共同体,产生了真正的更大规模的交融,体现了伦理意义上的包容性。戴茂堂还向各位嘉宾介绍了人工智能伦理治理实验室的基本情况。实验室成立于2022年6月。2023年7月,实验室升格为北师大珠海校区唯一的新文科类“揭榜挂帅”重点科研平台。实验室重点开展四项工作,分别是:举办人工智能伦理治理工作坊,开展人工智能伦理治理学术研究,推动人工智能伦理治理研修培训,制定人工智能产品伦理评估体系。前两项是学理性的、也是常规性的,后两项是实践性的、也是探索性的。这次的研修会通过聘请主讲嘉宾进行专题讲授与邀请参会嘉宾进行小组交流的形式来展开研修培训就是一种实践探索。此前,实验室立足于人工智能和机器人前沿技术,在全国高校通过积极推进以机器人为代表的人工智能伦理专题辩论赛和睿抗机器人大赛,开展了AI伦理治理人才培训。其中“睿抗CAIR机器伦理专题辩论赛”旨在提升大学生对于人工智能的理解力、对于人工智能产生的伦理风险的判断力,加强大学生社会责任感和对社会问题的前瞻意识,并通过大学生这个特殊群体唤醒全社会对于人工智能伦理治理问题的真心关切,实现对AI伦理治理更全面的理解。“睿抗机器人大赛”秉承为教育服务、为社会服务的高质量发展原则,着眼于机器人的技术开发和人文把关双重责任,从“为学校发掘有潜力的好苗子、为社会挑选 更匹配的人才”出发 ,紧紧社会培养和实践培育,努力搭建科技教育与伦理治理相融合的开放共享平台, 以传递人工智能社会服务的公正、可持续和安全理念,引导人工智能技术向“可持续、包容性、有温度、负责任”的方向发展,以期为AI的发展提供更清晰的伦理指南。睿抗机器人大赛已自主发起、影响广泛的实践品牌,成功入选“中国高等教育学会全国普通高校学科竞赛排行榜”。后两项做好了,就能展现人工智能伦理治理实验室的特色。

12月23日上午和24日上午,本次会议举办了两场主旨报告,共有六位专家做主旨报告。第一场主旨报告于12月23日上午举行,由北京师范大学哲学国际中心任丑教授主持。

上海交通大学凯源法学院郑戈教授以《自动驾驶汽车算法设计中的伦理考量》为题进行主旨演讲。他指出,伦理考量是自动驾驶汽车算法设计中不可缺少的因素,但企业出于利益最大化的动机往往缺乏内生激励来将伦理考量纳入自己的产品设计流程,因此需要国家通过法律来促使或迫使企业追求符合伦理的设计。同时,伦理原则不能只是恰好被赋予伦理把关权的那些人的个人道德偏好的表述,而必须是社会共识的产物,符合一般性的社会预期,因此需要通过制度设计来引导社会展开自动驾驶方面的伦理问题研究和讨论,促进社会共识的形成。从长远来看,重视伦理考量的商业氛围和社会环境不仅有利于企业竞争力的形成,而且有助于一个国家的整个行业获得国际竞争力。他认为,在思考自动驾驶汽车伦理问题时,应当避开电车难题,或至少要将它摆到相当次要的位置。电车难题的意义在于训练人的伦理思维,而不适合用来训练机器。相较于伦理学层面的演绎推理式讨论,对相关立法、伦理原则发展和公共政策制定更有帮助的是社会科学的经验研究。他主张,我国应借助已有的国际磋商机制(比如联合国、G20、东盟等等)积极提出并倡议本国提炼和发展出的自动驾驶汽车算法伦理原则,参与和引领相关国际标准和规则的形成与制定,为未来交通注入中国元素,创造中国空间。

电子科技大学马克思主义学院雷瑞鹏教授以《医学人工智能的伦理和治理问题》为题进行主旨演讲,基于对人工智能的概念和发展状况的分析,讨论了人工智能的伦理问题和治理问题。她认为,人工智能的应用会引起规范性的伦理问题(ethical issues),既涉及到应该做什么的伦理问题,又涉及到应该如何做的伦理问题。伦理问题分为近期AI的伦理问题、中期AI的伦理问题、远期AI的伦理问题。其中:近期AI的伦理问题即与机器学习、算法、大数据、大语言模型有关的伦理问题应该成为讨论的重点。她强调,不同于“自上而下”的监管,治理是立体的网络式的,是所有利益攸关者参与的治理。人工智能的治理方案应当从人工智能给人们带来什么风险/伤害与受益出发,遵循以风险为基础或把控制风险放在首位的径路。以风险为基础的径路坚持安全第一,以人为本,是一种以后果为导向的(consequence-oriented)径路。

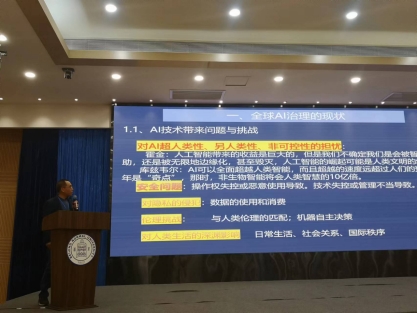

广西大学杨通进教授以《全球AI治理的国际伦理基础》为题进行主旨演讲,阐述了全球AI治理的现状与趋势、面临的伦理挑战以及国际伦理建设的方案。在分析全球AI治理的现状与趋势时,杨教授认为,AI治理有行业治理、国家治理、跨国与区域治理、全球治理之别,重点介绍了欧盟AI治理和《布莱切利宣言》,分析了人们对AI超人类性、另人类性、非可控性和对AI侵害隐私、破坏生活秩序的担忧。杨教授认为,AI治理攸关全人类命运,是世界各国面临的共同课题。各国应秉持共同、综合、合作、可持续的安全观,坚持发展和安全并重的原则,通过对话与合作凝聚共识,构建开放、公正、有效的治理机制,不断提升人工智能技术的安全性、可靠性、可控性、公平性,促进人工智能技术造福于人类,推动构建人类命运共同体。在分析全球AI治理面临的伦理困境时,杨教授认为,治理与创新难以平衡、软法(伦理)向硬法(国际法)难以转变、全球利维坦缺失、现实主义国际伦理观盛行是最为突出的伦理困境。在分析国际伦理建设与全球AI治理时,杨教授主张,全球AI治理离不开国际合作,国际合作以价值共识的增加与国际制度的完善为前提,批判和反思现实主义的国际伦理观有助于消除国际合作的障碍,培育和倡导世界主义的国际伦理观有助于建立更加公平合理的世界秩序,公平合理的世界秩序是实现全球AI治理的制度保障。

第二场主旨报告于12月24日上午举行,由《山东社会科学》杂志社编审周文升主持。

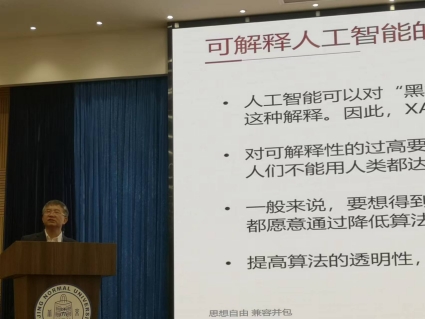

北京大学哲学系周程教授以《医学人工智能伦理:从可解释性到可信赖信》为题进行主旨演讲,在介绍人工智能第三次浪潮与ChatGPT的问世之后,周教授认为,透明性是人工智能伦理治理讨论中关键议题,算法缺乏透明性产生的“黑箱”问题不可避免地会影响到人工智能的应用与推广。在医学领域,人工智能不透明性表现为:算法的开发者位于内部层次,他们无法预知算法的结果;接受医疗服务的患者位于外部层次,他们无法向系统询问输出某一决策结果的原因;医生则位于内外交互层次,他们既无法理解数据输入与输出间的因果关系,也无法向患者作出合理的解释。算法黑箱对于算法专家、医疗专家、患者和公众来说,是一个严峻的伦理挑战。于是,透明度、公平和正义、非恶意、责任和隐私已成为设计人工智能的基本原则与指导方针,其中透明度位居首位。随之,人工智能的可解释性、可理解性和可信赖性问题也提了出来。可解释性人工智能包含原理可解释、过程可解释、模型可解释、结果可解释等不同维度的要求,存在多种不同的实现方式。周教授强调,对可解释性的过高要求是不公平的,人类做决定的时候也不都是透明的,人们不能用人类都达不到的标准来要求机器。可解释的AI并不一定是可理解的AI。人类对可理解AI的要求在于让AI处理基于语境的因果关系。由于不同使用者所处的语境不同,因此要求AI在实际应用中呈现出的可理解程度存在差异。人类所追求的合伦理AI,核心在于构建可信赖AI。可信赖的人工智能则涉及更多人类价值的考量,不仅仅要求AI能表征普遍的、形式化的因果关系,也不仅仅要求AI能表征特定语境下的因果关系。满足稳健性、可干预性、易操作性、可监督性、可供审查性等要求的AI则更值得信赖。如果从因果关系的视角出发,我们似乎可以对与人工智能透明性相关的可解释性、可理解性以及可信赖性这组概念进行这样的刻画:可解释性(explanability)人工智能算法符合人类对逻辑主义因果的要求;可理解性(understandability)人工智能算法符合人类对语境主义因果的要求;可信赖性(trustworthiness)人工智能算法符合人类对多元主义因果的要求。

东南大学王珏教授以《数字经济的伦理期待》为题,以数字传奇与造富神话为切入点展开反思,分析了数字经济的伦理挑战、资本逻辑和伦理共生的建构方案。王教授认为,数字经济是以数据资源为关键要素,以数字平台及其生态为主要载体,通过数字化和智能化实现高效连接,在物理世界和数字空间都可以创造价值的一种新型经济形态。数字经济不只是简单的技术问题、经济问题,而是人类进入更高层级的社会变革,它的特点是打破了时间空间对人类生产生活的限制,对社会整体产生结构性颠覆与重构。在数字经济时代,数字资本家的价值榨取与财富积累并未随着新技术的推广而削减,反而全方位地加深了。剥削的范围、工具、方式等都发生了重要变化。平台成为新的生产组织中心,加剧了国与国之间以及国家内部的贫富差距,“吞噬”着世界,引发平台企业自身发展责任缺失和平台经济业态发展不正当竞争等问题。“数字经济,伦理在场”,应该成为伦理工作者的自觉使命。王教授认为,要增加透明度和参与度,加强数字平台自我治理的;要反垄断和反不公平竞争,寻求伦理共生,加强数字平台生态建设。

北京师范大学哲学学院田海平教授以《AI价值对齐的康德式辩护》为题,主张机器向人“对齐”,提出了两条自明性原则。其中,第一条是“‘人是目的’的善行原则”,它旨在解决“绝对可信赖”问题;第二条是“‘自我立法’的正当性原则”,它旨在解决“普遍可信赖”问题。主张以“算法人文”成全“精神人文”以及算法从善与“AI向善而行”的双底线原则,认为需要从人文价值高度重新厘定人工智能的“人工性”,将人工性限定在人类的精神人文限度内,以规避人工智能隐蔽的伦理风险,人工智能的发展不可损害人和人类的尊严。田教授认为,人工智能的“人工性”之称谓存在某种程度的误导,需要以“人文性”视角发掘其中负载的人文价值选择和责任。这是规避人工智能隐蔽的伦理风险的前提。

12月23日下午,本次会议共组织了四场分会场会议,每个分会场的讨论均分上半场和下半场。12月24日上午,在北京师范大学人工智能伦理治理实验室主任戴茂堂教授的主持下,北京中医药大学袁和静教授、pp电子游戏网站杨海军副教授、中山大学马院吴之声助理教授、西南大学应用伦理研究所黎松副教授分别代表北京市伦理学会、湖北省伦理学学会、广东省伦理学学会和重庆市伦理学学会向大会对四个分会场的讨论进行了总结汇报。

第一分会场由北京伦理学学会牵头,在北京师范大学珠海校区励教楼 C304教室举行。中共北京市委党校鄯爱红教授任上半场讨论的召集人,燕强、余玉花、涂爱荣、黄雪梅、张倩倩等 26位嘉宾参与了讨论。北京科技大学赵爱玲教授任下半场讨论的召集人,鄯爱红、李梦删、费雪莱、夏永红等25位嘉宾参与了讨论。北京中医药大学袁和静教授在总结汇报中指出,本分会场共有九位老师进行专题学术报告,本分会场的讨论达到了预期的讨论效果,主要围绕着三个问题展开研讨,首先是基于理论的思考和审视来去讨论人工智能的问题怎么从理论上解决;第二个讨论的问题是如何看待人工智能发展带来的很多问题、影响和危机;第三个是人工智能在现实应用中遇到了问题以及怎么去解决的问题。

第二分会场由湖北省伦理学学会牵头,在北京师范大学珠海校区励教楼 C305教室举行。武汉大学哲学学院陈江进教授任上半场讨论的召集人,李家莲、程宏燕、熊富标、胡楠、马啸风等24位嘉宾参与了讨论;武汉理工大学程宏燕教授任下半场讨论的召集人,闫坤如、黄云明、杨海军、王冰洁等24位嘉宾参与了讨论。pp电子游戏网站杨海军副教授在总结汇报中指出,本分会场的讨论主要从三个视角展开,第一个视角是本体论的视角,也就是说,是人工智能理论本体论视角;第二个视角是马克思主义的视角;第三个视角是现实的伦理风险视角。本分会场共有9场学术报告,报告结束后,本分会场花了很长时间对主讲嘉宾的报告展开了讨论,既有一对一的讨论,也有对本会场讨论的总体情况的综合性评价。

第三分会场由广东省伦理学学会牵头,在北京师范大学珠海校区励教楼 C306教室举行。华南农业大学唐士红教授任上半场讨论的召集人,曾点、陈玲、茶志强、邹林华、鲁琴等24位嘉宾参与了讨论;广东对外经贸大学马克思主义学院薛俊强教授任下半场讨论的召集人,江峰、张耀天、喻学林、吴秀莲等24位嘉宾参与了讨论。中山大学马克思主义学院吴之声助理教授在总结汇报中指出,本分会场共有九位老师进行专题学术报告,九位学者的学术报告主要围绕着人工智能的核心关键词、前沿问题和伦理治理问题展开,综合看来,第三分会场的讨论主要从以下四个方面展开:人工智能的研究现状、人工智能的伦理审视、人工智能的伦理治理以及人工智能的应用实践。在本分会场的点评环节,广东财经大学的袁继红教授和武汉纺织大学的喻学林教授对讨论进行了精彩点评。

第四分会场由重庆市伦理学学会牵头,在北京师范大学珠海校区励教楼C307教室举行。西南大学王俊杰副教授任上半场讨论的召集人,黎松、马昕、李育侠、金钊等25位嘉宾参与了讨论;西南大学黎松副教授任下半场讨论的召集人,王俊杰、任美慧、寇楠楠、张家赫等24位嘉宾参与了讨论。西南大学应用伦理研究所黎松副教授在向大会做总结汇报时指出,本分会场的讨论主要围绕从人工智能的应用的基础理论、人工智能的立法以及人工智能在神经技术临床的应用而展开。讨论结束后,南京大学马克思主义学院陈继红教授对本分会场的讨论进行了精彩点评。

继所有主旨报告、分会场会议以及分会场总结汇报后,12月24日上午,由北京师范大学哲学国际中心夏永红副研究员主持,本次会议举行了闭幕式。夏永红副研究员指出,本次大会形式创新,讨论热烈,说明大家对人工智能的伦理治理问题非常关心,所以讨论起来就无比认真。另外,很多硕博士研究生参与到了本次大会,这是很好的。本次大会不仅有高度,而且有宽度,讨论有深度,东西南北上下都有关照,十分难得。

武汉大学应用伦理学研究中心执行主任陈江进教授对本次大会进行了总结。他指出,本次大会形式新颖,为我们留下了大量思考的空间。本次会议的讨论可分为三个部分,一是致辞部分,与以往的领导讲话不同的是,本次会议从致辞都变成了一个小型学术报告;二是主旨演讲部分,一共有六场主旨演讲,六位专家都贡献了自己最新的关于人工智能的思考;三是四个分会场。与会专家是一直是认识到人工智能给我们带来的影响,也认识到我们要强调跨学科合作的必要性,唤起共同应对人工智能的伦理问题的责任感,听了大家对人工智能伦理治理问题的讨论,我也分享一下我个人的困惑,第一个困惑是,我们害怕技术开发者变得狂妄起来,那么,我们伦理学哲学工作者总想着要为人工智能立法的时候,我们是否也一样狂妄呢?第二个困惑是,人工智能的运作是黑箱,那么,它本身就是不确定的,谁也不知道会出现什么。第三个困惑是,很多问题,我们人类都没有搞清楚,最后却要机器人去负责,这是不是很过分呢?第四个困惑是人工智能里面的本质主义倾向,人工智能到底有没有意志?只有算法,没有情感、体验以及对死亡的体验,真的很糟糕吗?没有人的世界一定很糟糕吗?总之,陈教授认为,我们需要思考和讨论的问题还有很多。

北京师范大学人工智能伦理治理实验室副主任曾点也对大会做了总结。曾点副从三个方面归结了本次会议的特点。第一,本次会议场面壮观。会议共有110人左右参与,主旨报告和各个分会场的报告加起来,共计有40余场,会议的气氛很热烈,既有专业性,学术性的严肃,又有生活性,日常性的活泼。本次会议也是人工智能伦理治理实验室建立以来。或许也是哲学国际中心建立以来规模最大型的一次会议。这确实是打开了我们人工智能伦理治理实验室建设的一番新局面,是别开生面。第二,本次会议风格别具一格。分会场的报告主题广泛,涵盖了中西马。各个哲学领域牵涉到文史哲各个人文学科,还充分体现了学科交叉,文理兼容的精神,不仅与政经法社等社会科学进行了深度交流,还有效地探讨了有关人工智能伦理治理的不少科学技术的问题。同时,会议也没有停留在就人工智能而论人工智能,而是扩展到了全社会、全世界乃至是全人类的层面进行探讨,意义很深远,也意味着责任重大。我们在相关方面的研究工作实践工作还大有可为。第三。本次会议别出心裁,设计很精巧。会议联合了京鄂粤渝四省市的伦理学学会共同举办。将四个省市伦理学学会的学术年会团结在了一起,可以说是创举,造就了我们如此多参会代表的积极一堂,也使得我们实验室和中心乃至整个珠海校区都蓬荜生辉,这样的会议设计十分独到精巧,既为我们搭建了更为广泛交流学习的平台,又为我们提供了旧友多多相聚、结识更多新朋友的机会。

最后,北京师范大学哲学国际中心主任、哲学学院王葎教授致闭幕词,感谢与会代表参与本次会议,周末12月22号老师们报到的时候,适逢我们的24节气的冬至,冬至本来是我们小家团圆的时刻,但各位老师、各位专家不远千里来到我们珠海校区,以这个学术家人的方式来团圆,特别感谢大家。其次,感谢戴茂堂教授为本次会议以及国际哲学中心的辛苦付出。除了感谢外,王葎主任还发出了诚挚的邀请,邀请学界同仁持续关心和支持人工智能伦理实验室。最后,王葎主任向与会代表表达了节日的祝愿。作为一个新的实验室,我们会议本次会议作为一个新的开端,即将迎来新年,祝愿与会的全体嘉宾们新年顺意、万事如意!

(审稿:李家莲)